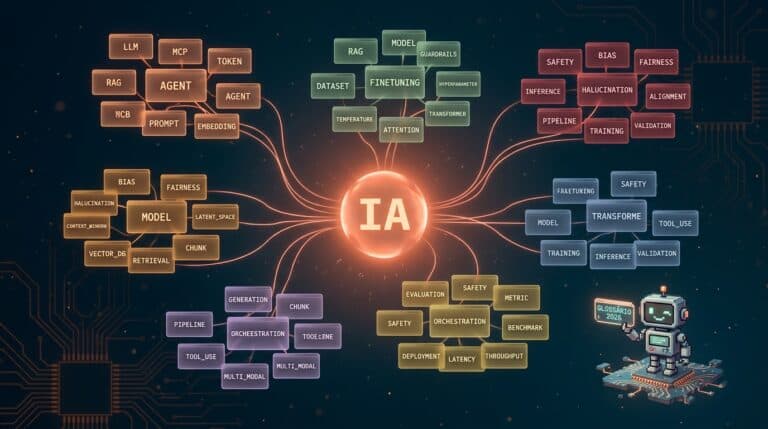

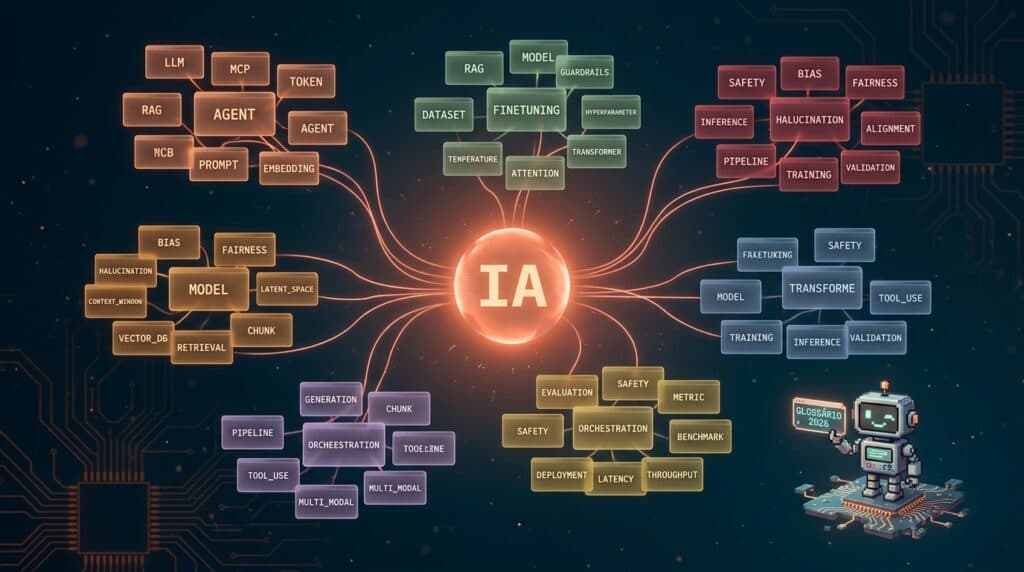

Entender os termos de IA em 2026 deixou de ser detalhe técnico e virou alfabetização básica. Afinal, conversar com qualquer ferramenta moderna exige entender o vocabulário por trás dela. Portanto, este glossário traz os 40 termos de IA mais importantes para iniciantes, organizados por categoria e explicados em linguagem direta. Além disso, cada definição vem com um exemplo prático para fixar o conceito.

Como usar este glossário de termos de IA

Primeiro, escolha a categoria que mais te interessa nos H2 abaixo. Em seguida, leia as definições em ordem ou pule direto para o termo desejado. Dessa forma, você economiza tempo e foca no que realmente importa. Por fim, salve esta página, porque o cenário de IA muda rápido e você vai consultar várias vezes ao longo do ano.

Conceitos fundamentais de IA

A seguir estão os 6 conceitos que servem como base para tudo o que vem depois. Portanto, domine essas definições antes de avançar para arquiteturas mais complexas.

- 1. IA (Inteligência Artificial)

- Campo da computação que cria sistemas capazes de executar tarefas que normalmente exigem inteligência humana. Exemplo: reconhecer rostos, traduzir textos ou sugerir filmes.

- 2. Machine Learning (ML)

- Subárea da IA em que o sistema aprende padrões a partir de dados, sem regras programadas manualmente. Exemplo: filtros antispam que melhoram sozinhos com o uso.

- 3. Deep Learning (DL)

- Subárea do ML que usa redes neurais profundas com várias camadas. Assim, captura padrões complexos em imagens, áudio e texto.

- 4. IA Generativa (GenAI)

- Categoria de IA que cria conteúdo novo (texto, imagem, código, vídeo). Exemplo: ChatGPT escrevendo um artigo ou Midjourney gerando uma ilustração.

- 5. NLP (Processamento de Linguagem Natural)

- Área que ensina máquinas a entender e produzir linguagem humana. Por exemplo, traduzir, resumir ou responder perguntas.

- 6. AGI (Inteligência Artificial Geral)

- Hipótese de uma IA com capacidade cognitiva equivalente à humana em qualquer tarefa. Em 2026 ainda é meta de pesquisa, não produto.

Modelos e arquiteturas

Aqui você encontra os 5 termos que descrevem como os modelos modernos são construídos. Em seguida, fica fácil entender por que GPT, Claude e Gemini funcionam de forma parecida.

- 7. LLM (Large Language Model)

- Modelo treinado em bilhões de palavras para prever a próxima palavra em uma sequência. Para ir mais fundo, leia esta explicação completa de LLM.

- 8. Transformer

- Arquitetura neural que substituiu redes recorrentes em 2017. Hoje é a base de praticamente todos os LLMs modernos.

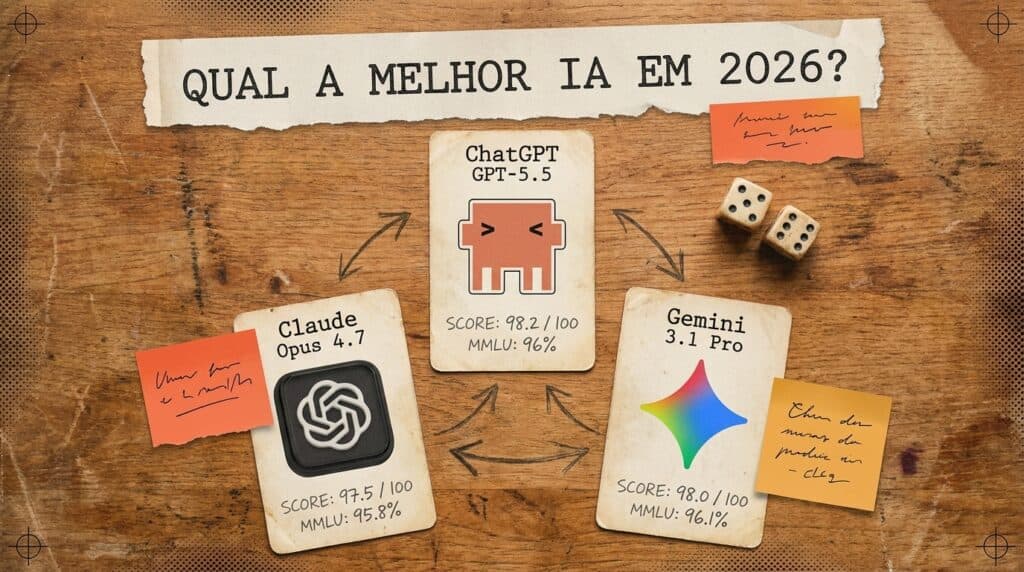

- 9. GPT / Claude / Gemini

- Famílias de LLMs criadas por OpenAI, Anthropic e Google, respectivamente. Veja o comparativo ChatGPT, Claude e Gemini em 2026 para escolher a melhor opção.

- 10. MoE (Mixture of Experts)

- Arquitetura que ativa só parte do modelo a cada consulta. Dessa forma, reduz custo computacional sem perder qualidade.

- 11. Multimodal

- Modelo que processa múltiplos tipos de entrada: texto, imagem, áudio e vídeo no mesmo prompt. Exemplo: mandar foto e perguntar o que está nela.

Treino e dados

Nenhum modelo de IA funciona sem dados de qualidade. Por isso, esses 7 termos explicam como o aprendizado acontece nos bastidores. Além disso, eles aparecem o tempo todo em papers e documentações oficiais.

- 12. Training (Treinamento)

- Processo em que o modelo ajusta bilhões de parâmetros expondo-se a um dataset gigantesco. Em geral, demora semanas e custa milhões.

- 13. Fine-tuning

- Etapa adicional em que se especializa um modelo já treinado em uma tarefa específica. Exemplo: adaptar um LLM para suporte jurídico.

- 14. Embedding

- Representação numérica de um texto, imagem ou áudio em vetores de alta dimensão. Assim, o modelo compara similaridade matematicamente.

- 15. Vector Database

- Banco de dados otimizado para armazenar e buscar embeddings. Por exemplo, Pinecone, Weaviate e Qdrant.

- 16. RAG (Retrieval-Augmented Generation)

- Técnica que conecta um LLM a uma fonte externa de dados antes de responder. Dessa forma, reduz alucinações e mantém respostas atualizadas.

- 17. Dataset

- Conjunto de dados usado para treinar ou avaliar um modelo. Exemplo: Common Crawl, ImageNet, LAION.

- 18. Parâmetros

- Pesos numéricos ajustados durante o treino. Em 2026, modelos top têm de centenas de bilhões a trilhões de parâmetros.

Comportamento dos modelos

Esses 7 conceitos descrevem como o modelo se comporta na hora de responder. Portanto, entender essas variáveis ajuda você a controlar a qualidade da saída.

- 19. Prompt

- Instrução em linguagem natural enviada ao modelo. Em geral, quanto mais claro o prompt, melhor a resposta.

- 20. Token

- Unidade básica que o modelo processa. Em português, costuma equivaler a uma sílaba ou palavra curta.

- 21. Context window

- Quantidade máxima de tokens que o modelo lê de uma só vez. Em 2026, varia de 128 mil a 2 milhões de tokens nos modelos top.

- 22. Temperatura

- Parâmetro que controla a aleatoriedade da resposta. Valores baixos geram saídas previsíveis; valores altos, criativas.

- 23. Alucinação

- Quando o modelo inventa informações com confiança. Por isso, sempre confira fatos críticos.

- 24. Latência

- Tempo entre enviar o prompt e receber a resposta. Em produção, latência baixa importa tanto quanto qualidade.

- 25. Inferência

- Etapa em que o modelo já treinado gera respostas. Diferente do treino, acontece toda vez que alguém usa.

Agentes e ferramentas: termos de IA em 2026

Esta é a categoria que mais cresceu no último ano. Afinal, em 2026 a discussão saiu de “o modelo escreve melhor?” para “o modelo executa tarefas?”. Em seguida, esses 7 termos de IA viraram obrigatórios para qualquer profissional.

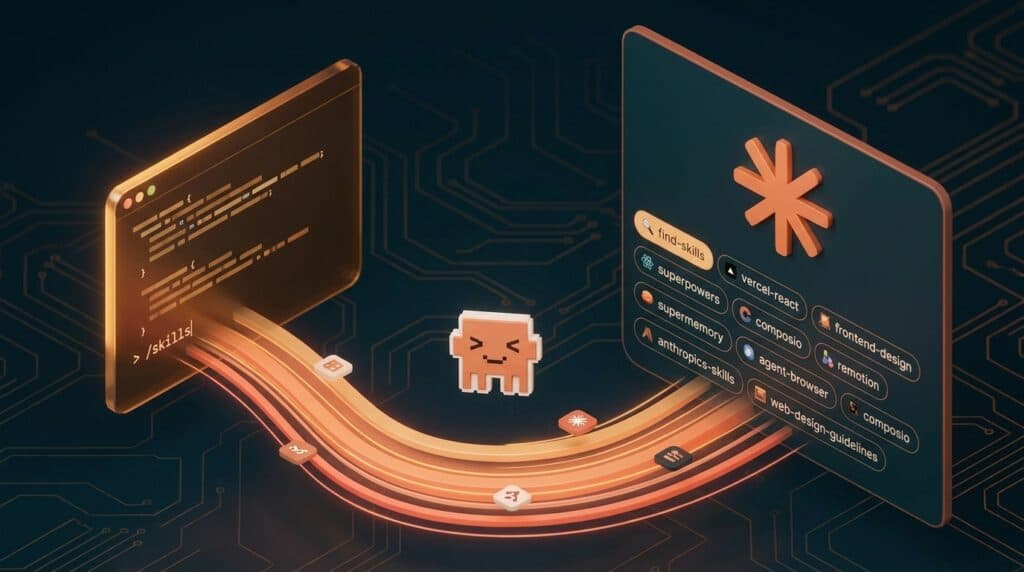

- 26. Agente de IA

- Sistema que recebe um objetivo e executa passos sozinho até completá-lo. Exemplo: agente que pesquisa, escreve e publica um artigo.

- 27. Agentic engineering

- Disciplina sucessora do vibe coding, focada em construir agentes confiáveis em produção. Para o quadro completo, veja o guia de agentic engineering.

- 28. MCP (Model Context Protocol)

- Protocolo aberto criado pela Anthropic para conectar LLMs a ferramentas externas de forma padronizada. Assim, virou o “USB-C da IA”.

- 29. Tool use

- Capacidade do modelo de chamar ferramentas externas (calculadora, API, busca) durante a resposta. Dessa forma, supera limitações nativas.

- 30. Function calling

- Mecanismo técnico que permite ao modelo invocar funções estruturadas. Por exemplo, retornar um JSON com argumentos prontos para executar.

- 31. Skills

- Pacotes reutilizáveis de instruções e ferramentas que estendem o agente. Veja as melhores skills do Claude Code em 2026.

- 32. Vibe coding

- Estilo informal de programar com IA descrevendo a intenção. Em 2026, está dando lugar ao agentic engineering em projetos sérios.

Avaliação, segurança e negócio

Por fim, esses 8 termos aparecem em conversas de produto, segurança e tomada de decisão. Portanto, são essenciais para quem vai além do uso casual e quer escolher ferramentas com critério.

- 33. Benchmark

- Teste padronizado para comparar modelos. Em geral, permite ver quem é melhor em raciocínio, código ou conhecimento geral.

- 34. MMLU / SWE-Bench / HumanEval

- Três benchmarks famosos. MMLU mede conhecimento geral, SWE-Bench testa correção de bugs reais, HumanEval avalia geração de código.

- 35. Alignment

- Conjunto de técnicas para alinhar o comportamento do modelo a valores humanos. Por isso, é central na pesquisa de segurança.

- 36. RLHF (Reinforcement Learning from Human Feedback)

- Método que ensina o modelo a partir de avaliações humanas. Assim, respostas melhoram em utilidade e segurança.

- 37. Guardrails

- Filtros e regras que impedem o modelo de gerar conteúdo perigoso. Exemplo: bloqueio de instruções para fabricar armas.

- 38. Jailbreak

- Tentativa de burlar os guardrails com prompts criativos. Por outro lado, motiva avanços contínuos em alignment.

- 39. API

- Interface que permite usar o modelo via código, em vez de interface web. Em 2026, é por aqui que produtos integram IA.

- 40. Free tier vs paid plan

- Diferença entre uso gratuito limitado e planos pagos com mais tokens, prioridade e recursos. Em geral, o free tier serve para teste.

Como continuar aprendendo

Agora que você conhece os 40 termos de IA essenciais, o próximo passo é praticar. Primeiro, aprofunde os fundamentos com a nossa explicação simples de LLM e o comparativo entre os 3 grandes modelos. Em seguida, explore o lado prático com o guia de agentic engineering e descubra as melhores skills do Claude Code. Por fim, para ampliar a base teórica, recomendo cursos gratuitos da Hugging Face, o artigo da Wikipedia sobre LLMs, o paper original Attention Is All You Need e a documentação oficial do MCP. Se quiser ver mais conteúdo na área, navegue pela nossa categoria IA.

Conclusão

Portanto, dominar os termos de IA é o primeiro passo para usar a tecnologia com critério em 2026. Lembre-se de que o vocabulário evolui rápido, mas a base aqui apresentada vai te dar segurança para acompanhar qualquer novidade. Por fim, salve este glossário, compartilhe com quem está começando e volte sempre que tiver dúvida.